KI im Fokus der Aufsicht

Banken müssen nachziehen – BaFin definiert Mindestanforderungen für den Einsatz von KI

Wichtig zu betonen ist die Vorläufigkeit des Prinzipienpapiers, welches noch keine Gesetzgebung ist, jedoch einen tiefen Einblick in die Denkweise der BaFin zum Thema Künstliche Intelligenz gibt und somit als Roadmap dienen kann.

Dabei teilt die BaFin ihre Bemerkungen zum Einsatz von Algorithmen in drei Abschnitte auf:

- Übergeordnete Prinzipien

- Spezifische Prinzipien für die Entwicklungsphase

- Spezifische Prinzipien für die Anwendung

Dies zeigt ein fundamentales Verständnis der BaFin für den Unterschied zwischen der Entwicklung einer KI-Anwendung und dem Betrieb in Produktion. Beide Phasen unterscheiden sich grundsätzlich von der Art und Weise, wie traditionelle Anwendungen entwickelt und betreut werden.

Definition von künstlicher Intelligenz und Abgrenzung zu bestehenden Methoden

Zu Beginn des Prinzipienpapiers versucht die BaFin zunächst, den Begriff der künstlichen Intelligenz zu definieren, und stellt fest, dass zum jetzigen Zeitpunkt keine klare Abgrenzung zu bestehenden klassischen statistischen Verfahren möglich ist.

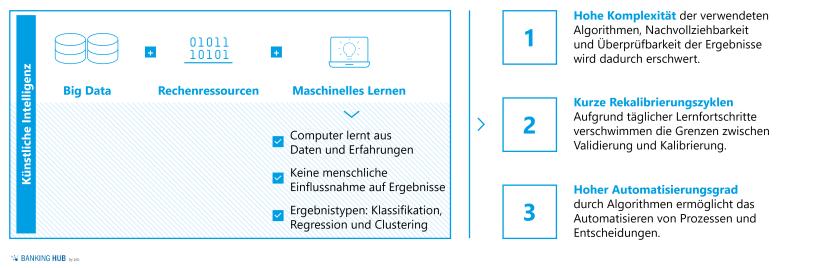

Unter künstlicher Intelligenz versteht die BaFin die Symbiose von großen Datenmengen, hoher Rechenleistung und maschinellem Lernen. Maschinelles Lernen ist ein Oberbegriff für Verfahren, die datengetrieben lernen. Hierbei wird nach Art der Algorithmen, Ergebnistypen (Klassifikation, Regression und Clustering) sowie Datentypen (Text, Sprache, Bilddaten) differenziert.

Abbildung 1: Abgrenzung von KI-Anwendungen zu statistischen Methoden

Abbildung 1: Abgrenzung von KI-Anwendungen zu statistischen MethodenDa maschinelles Lernen auf statistische Modelle zurückgreift, die bereits in Form von klassischen Regressionen in Finanzinstituten genutzt werden, gelten die in diesem Papier definierten Prinzipien grundsätzlich für alle Arten von Entscheidungsprozessen, die durch Algorithmen unterstützt werden. Dies beinhaltet auch bereits etablierte statistische Entscheidungsmodelle. Deshalb erkennt die BaFin eine Notwendigkeit zur Abgrenzung von künstlicher Intelligenz zu diesen bestehenden Methoden. Hierfür wurden drei wesentliche Merkmale definiert, die künstliche Intelligenz charakterisieren:

- Hohe Komplexität der zugrunde liegenden Algorithmen

- Kurze Rekalibrierungszyklen

- Hoher Grad an Automatisierung

Dennoch fehlt bei dieser Definition weiterhin die Trennschärfe zu den bereits in Banken verwendeten statistischen Regressionsmodellen. Deshalb ist zu erwarten, dass die Aufsicht die Definition präzisieren wird.

BankingHub-Newsletter

„(erforderlich)“ zeigt erforderliche Felder an

KI-Prinzipien der BaFin

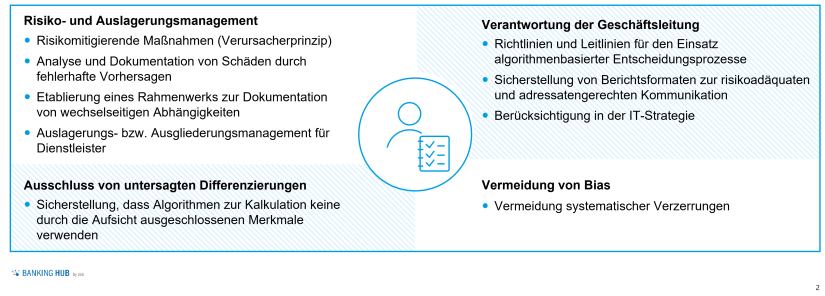

Übergeordnete Prinzipien für die Verwendung von künstlicher Intelligenz

Für die Verwendung von künstlicher Intelligenz sind Richtlinien durch die Geschäftsleitung zu definieren. In diesen Richtlinien sollten sowohl das Potenzial als auch die Grenzen und Risiken der Technologie erfasst, risikomitigierende Maßnahmen festgelegt und die bestehenden IT-Strategien entsprechend erweitert werden.

Hierfür ist eine umfassende Analyse potenzieller Schäden durch sowohl unmittelbare fehlerhafte algorithmenbasierte Entscheidungen als auch wechselseitige Abhängigkeiten zwischen verschiedenen KI-Anwendungen vorzunehmen. Um diese Anforderungen adäquat zu erfüllen, muss das notwendige technische Verständnis für künstliche Intelligenz direkt im Vorstand etabliert werden.

Neben der Festlegung der Verantwortlichkeit im Vorstand hebt die BaFin in den übergeordneten Prinzipien die Bedeutung der Vermeidung systematischer Verzerrungen (Bias) sowie der Beachtung von bestehenden, gesetzlich untersagten Differenzierungen hervor. Die Einhaltung dieser Prinzipien hängt entscheidend von den zugrunde liegenden Trainingsdaten ab.

Unter einer systematischen Verzerrung versteht man die Voreingenommenheit der KI, welche durch fehlerhafte oder unvollständige Daten oder durch mangelhafte Verarbeitung hervorgerufen wird. Dabei übernimmt der Computer die bewusste oder auch unbewusste menschliche Voreingenommenheit und leitet daraus logische Schlüsse ab. Dadurch können Personengruppen, Ethnien oder Minderheiten systematisch diskriminiert und benachteiligt werden.

Ein bekanntes Beispiel für Verzerrungen, die durch künstliche Intelligenz hervorgerufen wurden, ist die Bevorzugung weißer Männer bei der Besetzung von Stellen bei einem Onlineversandhändler. Dort hatte der Algorithmus aus den Trainingsdaten geschlossen, dass weiße Männer erfolgreicher im Unternehmen arbeiteten. Dieses Ergebnis war jedoch aufgrund der zugrunde liegenden Trainingsdaten verzerrt. Solche Diskriminierungen können durch menschliche Vorurteile entstehen oder auch durch die Verwendung von bestimmten Merkmalen, welche bereits nach geltenden Gesetzen nicht zur Differenzierung genutzt werden dürfen.

Dieses Beispiel macht deutlich, wie wichtig die Auswahl und Aufbereitung der Trainingsdaten ist, gleichzeitig zeigt es die Grenzen künstlicher Intelligenz auf: Der Computer lernt nicht nur, Zusammenhänge zu erkennen, er lernt auch durch unsere Vorurteile und Präferenzen. Zur Einhaltung dieser enormen Verantwortung, die mit der Auswahl der Daten einhergeht, fordert die BaFin deshalb einen übergeordneten Überprüfungsprozess, welcher jegliche Diskriminierung im Institut verhindern soll. Dies führt dazu, dass Institute ein noch höheres Interesse für qualitativ hochwertige Daten entwickeln müssen, und birgt die Chance, bisher etablierte Diskriminierungen in Prozessen aufzudecken und Entscheidungen zukünftig fairer zu treffen.

Spezifische Prinzipien für die Entwicklungsphase

Neben den übergeordneten Leitlinien werden sowohl Prinzipien für die Entwicklung von KI-Anwendungen als auch für ihre spätere Verwendung formuliert.

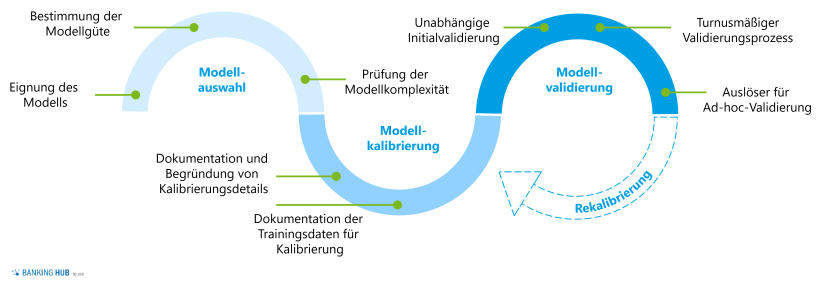

Die BaFin fordert die Dokumentation und Speicherung der Trainingsdaten sowie eine hohe Datenqualität und hinreichende Quantität. Nur durch diese Datenspeicherung ist es möglich, nachträglich Daten zu identifizieren, die zu Verzerrungen in den KI-Entscheidungen geführt haben und deshalb in einem Validierungsprozess aus der Trainingsdatenmenge entfernt werden müssen. Dadurch wird die Nachvollziehbarkeit und Reproduzierbarkeit der KI-Ergebnisse ermöglicht.

Wobei zu beachten ist, dass besonders komplizierte Modelle für KI – wie beispielsweise neuronale Netze – kaum die Anforderung der Nachvollziehbarkeit erfüllen können. Damit schränkt die BaFin Finanzinstitute in der Komplexität von KI und der damit verbundenen Chance durch ihre Nutzung ein.

Die Einführung von KI-Lösungen erfordert neben der Auswahl von qualitativ hochwertigen Trainingsdaten auch beispielsweise die Aufbereitung dieser Trainingsdaten, die Auswahl geeigneter Algorithmen sowie die Festlegung von Parametern. Erst durch das Ausprobieren verschiedener Modelle kann eine geeignete KI entwickelt werden. Deshalb fordert die BaFin die Dokumentation und Begründung der Modellauswahl, Modellkalibrierung und der Modellvalidierung und damit auch indirekt die Überprüfung mehrerer Modelle zur Identifizierung eines geeigneten Modells.

Spezifische Prinzipien für die Anwendung – der Mensch als zentrale Kontrollinstanz

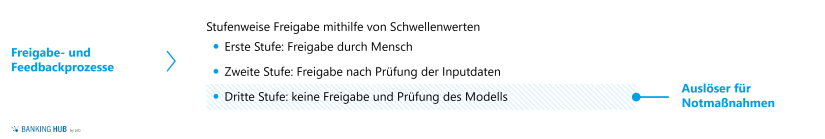

Mithilfe von künstlicher Intelligenz können Prozesse automatisiert und Entscheidungen durch den Computer getroffen werden. Um eine hohe Qualität dieser Entscheidungen sicherzustellen und sie zu interpretieren, sind eine regelmäßige Validierung und die stetige Kontrolle durch den Menschen unerlässlich. Diese wichtige Rolle erkennt die BaFin an und formuliert hierfür mehrere Mindestanforderungen.

Die Kontrollmechanismen durch den Menschen sollen durch die folgenden Tätigkeiten (Mindestanforderungen) sichergestellt werden:

- Aufgrund der Verwendung von KI-Ergebnissen als Input für weitere KI-Anwendungen müssen mögliche Risikoaggregationen berücksichtigt und erfasst werden. Das bedeutet, dass für jede KI-Anwendung geprüft werden muss, ob die Inputdaten bereits durch eine KI bestimmt wurden und welche Fehler dadurch entstehen können. Dies könnte beispielsweise der Fall sein, wenn in einem KI-gestützten Kreditvergabeprozess die Kreditwürdigkeit eines Kunden mittels künstlicher Intelligenz bestimmt wurde. Auf diese Weise kann eine Ungenauigkeit bei der Festlegung der Kreditwürdigkeit zu weiteren Ungenauigkeiten und Fehlern im Vergabeprozess führen.

- Unabhängig von der Geschäftskritikalität der Applikation muss der Output aus der KI-Anwendung auf seine Korrektheit und Interpretierbarkeit überprüft werden. Mit solchen Interpretierbarkeitsanalysen (z. B. Einstellung von überwiegend weißen Männern aufgrund von Vorurteilen) können Fehler oder Ungenauigkeiten in den Trainingsdaten identifiziert werden.

- Durch plausible Interpretation, die über reine Freigabeprozesse hinausgeht, z. B. durch einen Limitprozess, können frühzeitig Überprüfungsprozesse der KI-Anwendung ausgelöst werden. Für solch einen Limitprozess kann beispielsweise bei einer Anwendung zur Betrugserkennung die Quote der erkannten Betrugsversuche genutzt werden. Verändert sich diese Quote im Laufe der Zeit, so wird eine Interpretierbarkeitsprüfung angestoßen. Eine Prozessanpassung zur Minimierung von Betrug könnte den Rückgang einer solchen Quote erklären. Kann jedoch keine Begründung für veränderte Ergebnisse gefunden werden, so ist eine Überprüfung des gesamten Algorithmus, der Inputdaten sowie der getroffenen Parameter vorzunehmen.

- Etablierung von Notfallmaßnahmen bei Ausfall der KI-Anwendung für geschäftskritische Prozesse.

- Turnusmäßige Validierung der Anwendung.

- Ad-hoc-Validierung beispielsweise bei häufigen Entscheidungsabweichungen, neuen externen oder internen Risiken.

Banken müssen sich auf regulatorische Anforderungen vorbereiten

Künstliche Intelligenz birgt immense Chancen für das Bankwesen´und gewinnt immer stärker an Relevanz. Die Entwicklung und Betreuung sowie die implementierten Kontrollmaßnahmen solcher Lösungen sind jedoch von großer Relevanz für den Erfolg von KI-Anwendungen.

Der Schaden, der durch fehlerhafte Algorithmen und nicht ausreichende Kontrollen entstehen kann, ist nur schwer zu beziffern, wird für die Finanzinstitute jedoch nicht nur von finanzieller, sondern auch von reputabler Art sein. Deshalb ist zukünftig mit einem größeren Fokus der Aufsicht auf die Verwendung von künstlicher Intelligenz zu rechnen.

Eine systematische und zeitnahe Aufbereitung sämtlicher regulatorischer Initiativen auf europäischer und nationaler Ebene findet sich in dem von zeb bereitgestellten Regulatory Hub. Dazu gehören auch die von der BaFin und der EU veröffentlichten Papiere zu KI.

Was ist zu tun?

zeb empfiehlt seinen Kunden, unmittelbar mit einer Inventur aller datengetriebenen Prozesse zu beginnen, um einen Überblick über potenzielle KI-Lösungen zu erlangen. Auf diese Weise können rechtzeitig Abhängigkeiten zwischen Algorithmen sowie geschäftskritischen Anwendungen identifiziert werden.

Das Ergebnis einer solchen Inventur ist eine KI-Anwendungslandkarte, welche die Verbindungen und Abhängigkeiten untereinander sowie zu anderen Anwendungen aufzeigt. Hierfür ist der Einsatz von (vordefinierten) Use Cases zu empfehlen, wie sie von zeb für die verschiedenen Bereiche (Risikomanagement, Vertrieb, Kreditprozesse etc.) entwickelt und in der Praxis erprobt wurden.

Für jede KI-Anwendung ist zu definieren, welche der von den Aufsichtsbehörden einzuhaltenden Prinzipien für sie relevant sind und in welchem Maße sie diese aktuell erfüllt. Dabei ist zu berücksichtigen, dass die Interpretation der Prinzipien für jeden Anwendungsfall Spielraum lässt. Daher ist hier eine konservative Herangehensweise zu empfehlen, welche die Prinzipien eher eng auslegt, um auf künftige aufsichtliche Überprüfungen angemessen vorbereitet zu sein.

Im Falle von Abweichungen bzw. Nichteinhaltung von Regelungen sind Maßnahmen zu definieren. Für neu zu entwickelnde KI-Anwendungen ist von vornherein ein Prozess aufzusetzen, der bereits bei der Entwicklung bzw. vor Einsatz die Einhaltung der regulatorischen Vorgaben sicherstellt.

Dabei sind auch die zukünftigen Regelungen der europäischen (siehe EU AI Act[2]) und nationalen Aufsichtsbehörden durch systematisches Monitoring der entsprechenden Veröffentlichungen der Aufsichtsbehörden einzubeziehen.

Eine Antwort auf “Regulatorische Anforderungen der BaFin an KI-Anwendungen”

Horst von Zuse

oberflächlicher Tüdelkram ohne inhaltlichliche Verbindung zur Informatik; typisch BaFin